🧠 Parte 1 — Introdução: o que é Big Data e por que ele domina o mundo hoje 🌎

Se você usa internet todos os dias — e provavelmente usa — você já está gerando dados o tempo todo.

- cada clique 🖱️

- cada busca 🔎

- cada vídeo assistido 🎬

- cada mensagem enviada 📱

👉 Tudo isso vira dados.

Agora imagine isso multiplicado por:

- milhões de pessoas

- bilhões de dispositivos

- sistemas funcionando 24h

👉 É aqui que nasce o conceito de Big Data.

📊 O que é Big Data (explicação real, sem enrolação)

Big Data não é só “muitos dados”.

👉 É um conjunto de dados tão grande e complexo que:

- não pode ser processado por ferramentas tradicionais ❌

- exige tecnologias específicas ✔️

⚙️ Os 5 pilares do Big Data (os famosos “5 Vs”) 🔥

🟢 Volume

Quantidade absurda de dados

- Terabytes

- Petabytes

- Exabytes

👉 Exemplo: redes sociais

🔵 Velocidade

Velocidade com que os dados são gerados

- em tempo real ⚡

- streaming contínuo

👉 Exemplo: sensores IoT

🟠 Variedade

Tipos diferentes de dados

- texto 📝

- imagem 📸

- vídeo 🎥

- logs de sistema

🔴 Veracidade

Qualidade dos dados

👉 dados podem ser:

- incompletos

- duplicados

- inconsistentes

🟣 Valor

O mais importante:

👉 transformar dados em informação útil

🧠 Por que Big Data é tão importante?

Porque hoje:

👉 quem tem dados, tem poder

📈 Empresas usam Big Data para:

- prever comportamento do cliente 🧠

- detectar fraudes 💳

- melhorar produtos 📦

- otimizar processos ⚙️

🧪 Exemplos reais do dia a dia

🎬 Netflix

- recomenda filmes baseado no seu comportamento

🛒 Amazon

- sugere produtos com base no seu histórico

- processa bilhões de mensagens

🚗 Uber

- calcula rotas em tempo real

👉 Tudo isso é Big Data em ação.

⚠️ O problema: dados sozinhos não servem pra nada

Ter dados não resolve nada.

👉 O que importa é:

- organizar

- analisar

- interpretar

🐍 Onde entra o Python nisso?

Aqui começa a parte mais interessante.

👉 Python virou a principal linguagem para Big Data.

💻 Por que Python domina o Big Data?

✔️ Simples de aprender

- sintaxe fácil

- leitura natural

✔️ Extremamente poderoso

- manipula grandes volumes

- integra com várias ferramentas

✔️ Ecossistema gigante

Principais bibliotecas:

- Pandas 📊

- NumPy 🔢

- Matplotlib 📈

- Scikit-learn 🤖

- PySpark 🔥

🧠 O diferencial do Python

👉 Ele conecta tudo:

- análise de dados

- machine learning

- automação

- integração com Big Data

⚡ Python + Big Data = combinação dominante

Hoje, praticamente todo ambiente de dados usa Python.

👉 desde pequenas empresas até gigantes como:

- Netflix

📉 O erro comum de quem está começando

Muita gente acha que:

👉 Big Data = só programação

Mas não é.

🧠 Big Data envolve:

- lógica

- análise

- interpretação

- arquitetura de dados

🔥 Outro erro comum

👉 querer aprender tudo ao mesmo tempo

Isso trava o aprendizado.

📌 Caminho correto

- entender dados

- aprender Python

- trabalhar com bibliotecas

- escalar para Big Data

🧩 Big Data não é só tecnologia

👉 É uma forma de entender o mundo através dos dados.

E o Python é a ferramenta que torna isso possível.

🧩 Manipulação de dados com Python (Pandas na prática) 📊🐍

Se Big Data é o “universo dos dados”, o Python precisa de ferramentas para trabalhar com ele.

👉 E a principal delas é:

👉 Pandas

🧠 O que é o Pandas?

O Pandas é uma biblioteca do Python criada para:

- manipular dados

- organizar informações

- analisar grandes volumes

👉 Ele funciona como uma mistura de:

- Excel 📊

- banco de dados 🗄️

- programação 💻

⚡ Por que o Pandas é tão poderoso?

Porque ele permite:

- ler arquivos grandes rapidamente 🚀

- filtrar dados com precisão

- transformar informações

- gerar análises

👉 tudo com poucas linhas de código

📦 Estrutura principal do Pandas

O Pandas trabalha com dois conceitos principais:

🟢 Series

👉 uma coluna de dados

Exemplo:

- lista de preços

- lista de nomes

🔵 DataFrame

👉 uma tabela completa

Exemplo:

| Nome | Idade | Cidade |

|---|

👉 Esse é o mais usado.

💻 Exemplo básico (prático)

import pandas as pddados = {

"Nome": ["Ana", "Carlos", "João"],

"Idade": [25, 30, 22]

}df = pd.DataFrame(dados)print(df)

👉 Isso já cria uma tabela completa.

📂 Lendo arquivos (uso real)

No mundo real, os dados vêm de arquivos.

📊 CSV (mais comum)

df = pd.read_csv("dados.csv")

📈 Excel

df = pd.read_excel("dados.xlsx")

👉 Aqui começa o Big Data na prática.

🔍 Visualizando os dados

Antes de sair analisando, você precisa entender o que tem na base.

df.head()

👉 mostra as primeiras linhas

df.info()

👉 mostra estrutura da base

df.describe()

👉 mostra estatísticas

🧠 Isso é MUITO importante

👉 técnico experiente SEMPRE começa explorando os dados

🧹 Limpeza de dados (etapa crítica)

Aqui entra um dos pontos mais importantes do Big Data:

👉 dados sujos = análise errada

⚠️ Problemas comuns

- valores nulos ❌

- duplicados ❌

- dados inconsistentes ❌

🔧 Remover valores nulos

df = df.dropna()

🔧 Preencher valores

df = df.fillna(0)

🔧 Remover duplicados

df = df.drop_duplicates()

👉 Isso é básico, mas essencial.

🔍 Filtrando dados (onde começa o poder)

Agora começa a parte interessante:

👉 extrair informação útil

Exemplo:

df[df["Idade"] > 25]

👉 filtra pessoas com mais de 25 anos

📊 Selecionando colunas

df["Nome"]

👉 pega apenas uma coluna

📈 Agrupamento de dados

Aqui entra análise real:

df.groupby("Cidade")["Idade"].mean()

👉 média por cidade

🧠 Isso já é análise de dados

👉 não é mais só tabela

🔥 Transformando dados

Você pode criar novas informações:

df["AnoNascimento"] = 2024 - df["Idade"]

👉 isso é transformação de dados

⚡ Performance no mundo real

Agora um ponto importante:

👉 Pandas é ótimo, mas tem limite

📉 Problema com Big Data

Quando os dados são MUITO grandes:

- milhões de linhas

- arquivos gigantes

👉 Pandas começa a ficar lento

🧠 Solução

Aqui entram ferramentas maiores:

- PySpark 🔥

- Dask

- Hadoop

👉 vamos falar disso na próxima parte

🧪 Caso real (estilo VMIA)

Situação:

- cliente com planilha gigante

- travando no Excel

Solução:

- uso de Python + Pandas

- limpeza + análise

Resultado:

👉 processamento muito mais rápido

⚠️ Erro comum

👉 tentar fazer tudo no Excel

💡 Realidade

Excel tem limite.

Python não.

🧠 Outro erro comum

👉 pular a limpeza de dados

Resultado:

- análise errada

- decisões ruins

📊 Visualização básica

df["Idade"].plot()

👉 gráfico simples

🧩 O Pandas é o coração da análise de dados com Python

👉 Ele transforma dados brutos em informação útil.

E isso é a base do Big Data.

🧩 Parte 3 — Big Data de verdade: Hadoop, Spark e processamento em escala 🔥📡

Até agora vimos:

- o que é Big Data

- como usar Python com Pandas

Mas existe um problema sério:

👉 o Pandas não aguenta Big Data de verdade

⚠️ Limitação do Pandas (muito importante)

O Pandas trabalha assim:

👉 carrega tudo na memória RAM

📉 Problema:

Se você tiver:

- 10 GB de dados → precisa de muita RAM

- 50 GB → já começa a travar

- 100 GB+ → praticamente inviável

👉 Aqui entra o Big Data real.

🧠 O que muda no Big Data de verdade?

Ao invés de:

👉 processar em uma máquina

Você passa a:

👉 processar em várias máquinas ao mesmo tempo

⚡ Conceito-chave: processamento distribuído

Em vez de 1 computador trabalhando:

👉 vários computadores dividem o trabalho

🧪 Exemplo simples

Arquivo gigante:

- 1 TB de dados 😵

Dividido em:

- 100 máquinas

👉 cada uma processa uma parte

👉 Resultado:

- mais rápido

- mais eficiente

- escalável

🟢 Apache Hadoop

O Hadoop foi um dos primeiros frameworks de Big Data.

📦 O que o Hadoop faz?

Ele resolve dois problemas:

1️⃣ Armazenamento (HDFS)

- divide arquivos grandes

- distribui em vários servidores

2️⃣ Processamento (MapReduce)

- divide tarefas

- processa em paralelo

⚠️ Problema do Hadoop

Apesar de poderoso:

- lento 😴

- complexo

- difícil de trabalhar

👉 E aí surge algo muito melhor…

🔥 Apache Spark

O Spark revolucionou o Big Data.

⚡ Por que o Spark é tão importante?

Porque ele:

- é MUITO mais rápido 🚀

- usa memória RAM (in-memory)

- integra com Python

🧠 Spark vs Hadoop

| Característica | Hadoop | Spark |

|---|---|---|

| Velocidade | lenta | muito rápida 🚀 |

| Processamento | disco | memória |

| Facilidade | difícil | mais simples |

👉 Hoje, o padrão é usar Spark.

🐍 Python + Spark = Big Data real

Aqui entra o protagonista:

👉 PySpark

🟣 PySpark

PySpark permite usar Python com Spark.

💻 Exemplo básico

from pyspark.sql import SparkSessionspark = SparkSession.builder.appName("BigData").getOrCreate()df = spark.read.csv("dados.csv", header=True)df.show()

👉 Isso já está processando dados em escala.

📊 Diferença prática

Pandas:

- roda no seu PC

PySpark:

- roda em cluster

👉 Isso muda tudo.

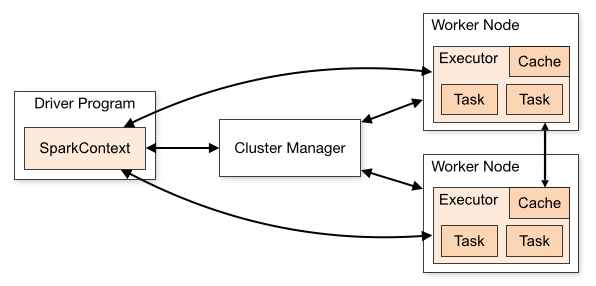

⚙️ Como funciona por trás (explicação técnica simplificada)

Quando você roda PySpark:

- dados são divididos 📦

- enviados para vários nós 🖥️

- processados em paralelo ⚡

- resultado é unificado

👉 isso é processamento distribuído.

🧠 Conceito importante: Lazy Evaluation

No Spark:

👉 ele não executa na hora

Ele:

- planeja

- otimiza

- executa depois

👉 isso aumenta MUITO a performance.

📡 Onde isso é usado na prática?

Empresas usam isso para:

- análise de milhões de usuários 👥

- processamento de logs 📄

- recomendação de conteúdo 🎬

- análise financeira 💰

🧪 Caso real (nível profissional)

Situação:

- empresa com milhões de registros

- Excel travando

- Pandas lento

Solução:

- migração para Spark

- processamento distribuído

Resultado:

👉 análise que levava horas → minutos

⚠️ Erros comuns

❌ Achar que Pandas resolve tudo

❌ Ignorar arquitetura de dados

❌ Não entender escalabilidade

🧠 Outro ponto crítico

Big Data não é só ferramenta.

👉 é arquitetura.

📊 Você precisa pensar em:

- armazenamento

- processamento

- fluxo de dados

- escalabilidade

🔥 Big Data moderno

Hoje usamos combinação de:

- Hadoop (armazenamento)

- Spark (processamento)

- Python (análise)

👉 stack completa.

🧩 Se Pandas é o começo…

👉 Spark é o nível profissional.

E o Python conecta tudo isso.

🧩 Parte 4 — Machine Learning com Python aplicado ao Big Data 🤖📊🐍

Até agora você entendeu:

- o que é Big Data

- como manipular dados com Pandas

- como escalar com Spark

Agora vem o próximo passo lógico:

👉 usar esses dados para prever, automatizar e tomar decisões inteligentes

🧠 O que é Machine Learning?

Machine Learning (aprendizado de máquina) é:

👉 fazer o computador aprender padrões sozinho a partir dos dados

💡 Em vez de programar regras:

Você fornece dados

👉 e o modelo aprende sozinho

🧪 Exemplo simples

Você quer prever:

👉 se um cliente vai comprar ou não

Você fornece:

- idade

- histórico

- comportamento

👉 o modelo aprende e começa a prever

📊 Tipos principais de Machine Learning

🟢 1. Supervisionado

👉 tem dados com resposta

Exemplo:

- spam / não spam 📧

- fraude / não fraude 💳

🔵 2. Não supervisionado

👉 não tem resposta pronta

Exemplo:

- agrupar clientes 🧠

- identificar padrões

🟣 3. Reforço

👉 aprende por tentativa e erro

Exemplo:

- jogos 🎮

- robôs 🤖

🐍 Python no Machine Learning

A principal biblioteca é:

👉 Scikit-learn

⚡ O que o Scikit-learn faz?

- cria modelos

- treina algoritmos

- faz previsões

💻 Exemplo prático

from sklearn.linear_model import LinearRegressionmodelo = LinearRegression()X = [[1], [2], [3]]

y = [10, 20, 30]modelo.fit(X, y)print(modelo.predict([[4]]))

👉 Ele aprende e prevê automaticamente.

📈 Aplicando isso no Big Data

Agora entra o ponto importante:

👉 Machine Learning precisa de dados

E o Big Data fornece isso.

🧠 Relação direta

- Big Data = dados

- Machine Learning = inteligência

👉 juntos formam sistemas poderosos

🔥 Exemplo real

🛒 E-commerce

- analisa milhões de compras

- prevê o que você vai comprar

🎬 Streaming

- recomenda filmes

💳 Bancos

- detecta fraude em tempo real

⚠️ Problema: Machine Learning sozinho não escala

Se você usar só Python básico:

👉 vai travar com muitos dados

🔥 Solução: Spark + Machine Learning

Aqui entra:

👉 MLlib (biblioteca do Spark)

🟠 MLlib

Ela permite:

- treinar modelos em escala

- processar grandes volumes

- rodar em cluster

💻 Exemplo com PySpark

from pyspark.ml.regression import LinearRegression

from pyspark.sql import SparkSessionspark = SparkSession.builder.getOrCreate()df = spark.read.csv("dados.csv", header=True, inferSchema=True)modelo = LinearRegression(featuresCol="features", labelCol="label")

👉 Aqui já estamos falando de Big Data real + IA

🧠 Pipeline de Machine Learning

No mundo real, funciona assim:

1️⃣ coleta de dados 📡

2️⃣ limpeza (Pandas/Spark) 🧹

3️⃣ análise 📊

4️⃣ treinamento 🤖

5️⃣ validação ✔️

6️⃣ produção 🚀

👉 Isso é chamado de pipeline.

⚠️ Erros comuns

❌ Treinar modelo com dados sujos

❌ Não validar resultado

❌ Overfitting (modelo “decorando”)

🧠 Conceito importante: Overfitting

👉 o modelo aprende demais os dados

Resultado:

- funciona no teste

- falha no mundo real

📉 Exemplo

- aprende padrões específicos

- não generaliza

💡 Solução

- dividir dados (treino/teste)

- usar validação

🔥 Outro conceito: Feature Engineering

👉 criar variáveis melhores

Exemplo:

- idade → faixa etária

- data → dia da semana

👉 isso melhora muito o modelo

🧪 Caso real (nível profissional)

Situação:

- empresa com muitos dados

- queria prever vendas

Solução:

- Python + Spark

- modelo de previsão

Resultado:

👉 aumento de lucro com decisões baseadas em dados

🚀 Tendência atual

Machine Learning está evoluindo para:

- IA generativa 🤖

- análise automática

- sistemas inteligentes

🧩 Machine Learning transforma dados em:

👉 decisões inteligentes

E com Big Data + Python:

👉 o potencial é gigantesco

🧩 Como começar do zero com Big Data e Python 🚀🐍📊

Depois de tudo que vimos, vem a pergunta mais importante:

👉 por onde começar na prática?

Porque entender o conceito é uma coisa…

👉 executar no mundo real é outra.

🧠 A realidade (sem romantizar)

Big Data + Python NÃO é algo que você aprende em:

- 1 semana ❌

- vendo vídeo aleatório ❌

👉 exige prática + sequência correta

⚠️ Erro mais comum

👉 querer aprender tudo ao mesmo tempo

Resultado:

- confusão mental 😵

- desmotivação

- abandono

📌 Caminho correto (método VMIA) 🔥

Vou te passar um caminho lógico e funcional:

🟢 Etapa 1 — Lógica de programação 🧠

Antes de tudo:

👉 aprenda lógica

- variáveis

- condições

- loops

🐍 Etapa 2 — Python básico

Aprenda:

- sintaxe

- listas

- dicionários

- funções

👉 base sólida

📊 Etapa 3 — Manipulação de dados

Ferramenta principal:

👉 Pandas

Aprenda:

- ler arquivos

- limpar dados

- filtrar

- agrupar

📈 Etapa 4 — Visualização

- gráficos

- análise visual

👉 entender dados na prática

🔥 Etapa 5 — Big Data (escala)

Ferramentas:

- Apache Spark

- PySpark

👉 aqui você sai do básico

🤖 Etapa 6 — Machine Learning

Ferramentas:

- Scikit-learn

- MLlib

👉 aqui você vira profissional

🧠 Etapa 7 — Projetos reais

Sem projeto:

👉 você não evolui

💡 Exemplos de projetos

- análise de vendas 📊

- previsão de preços 💰

- análise de logs 📄

- dashboard de dados 📈

👉 isso constrói portfólio

⚠️ Outro erro comum

👉 só estudar teoria

Resultado:

- não sabe aplicar

- trava na prática

🚀 Como estudar de forma eficiente

✔️ Aprenda fazendo

✔️ Resolva problemas reais

✔️ Refaça projetos

📉 O que NÃO fazer

- pular etapas

- copiar código sem entender

- estudar sem prática

🧠 Mercado de trabalho (realidade)

Big Data + Python é uma das áreas mais valorizadas hoje.

💼 Cargos comuns

- Analista de Dados 📊

- Engenheiro de Dados ⚙️

- Cientista de Dados 🤖

💰 Por que paga bem?

Porque envolve:

- alta complexidade

- impacto direto em decisões

- escassez de profissionais

📈 Crescimento da área

A tendência é:

👉 só aumentar

🔥 Diferencial competitivo

Quem domina:

- dados + Python + análise

👉 se destaca MUITO

🧠 Perfil ideal

Você não precisa ser gênio.

Mas precisa:

- raciocínio lógico

- curiosidade

- consistência

🧪 Caso real (inspirador)

Situação:

- pessoa começando do zero

- sem experiência

Caminho:

- Python → Pandas → projetos

Resultado:

👉 conseguiu vaga na área

⚠️ Verdade importante

👉 não existe atalho

Mas existe método.

🧩 Big Data com Python não é só tecnologia

👉 é uma habilidade estratégica

Que permite:

- entender dados

- prever cenários

- tomar decisões inteligentes

🚀 E o mais importante

👉 você pode começar do zero

🚀 VMIA

🌟 Quer aprender tecnologia de forma prática e sem enrolação?

Na VMIA você encontra conteúdo técnico real, direto ao ponto, baseado em experiência de campo.

🔧 Suporte técnico

💻 Consultoria

📊 Conteúdo avançado

👉 Acesse: https://vmia.site

👉 Blog: https://vmia.com.br

👉 WhatsApp: https://whats.vmia.com.br

📞 (11) 99779-7772

🖼️ IMAGEM DE DESTAQUE

4

Faça um comentário